資訊專欄INFORMATION COLUMN

摘要:近幾年,深度學習高速發展,出現了大量的新模型與架構,以至于我們無法理清網絡類型之間的關系。是由深度學習先驅等人提出的新一代神經網絡形式,旨在修正反向傳播機制。當多個預測一致時本論文使用動態路由使預測一致,更高級別的將變得活躍。

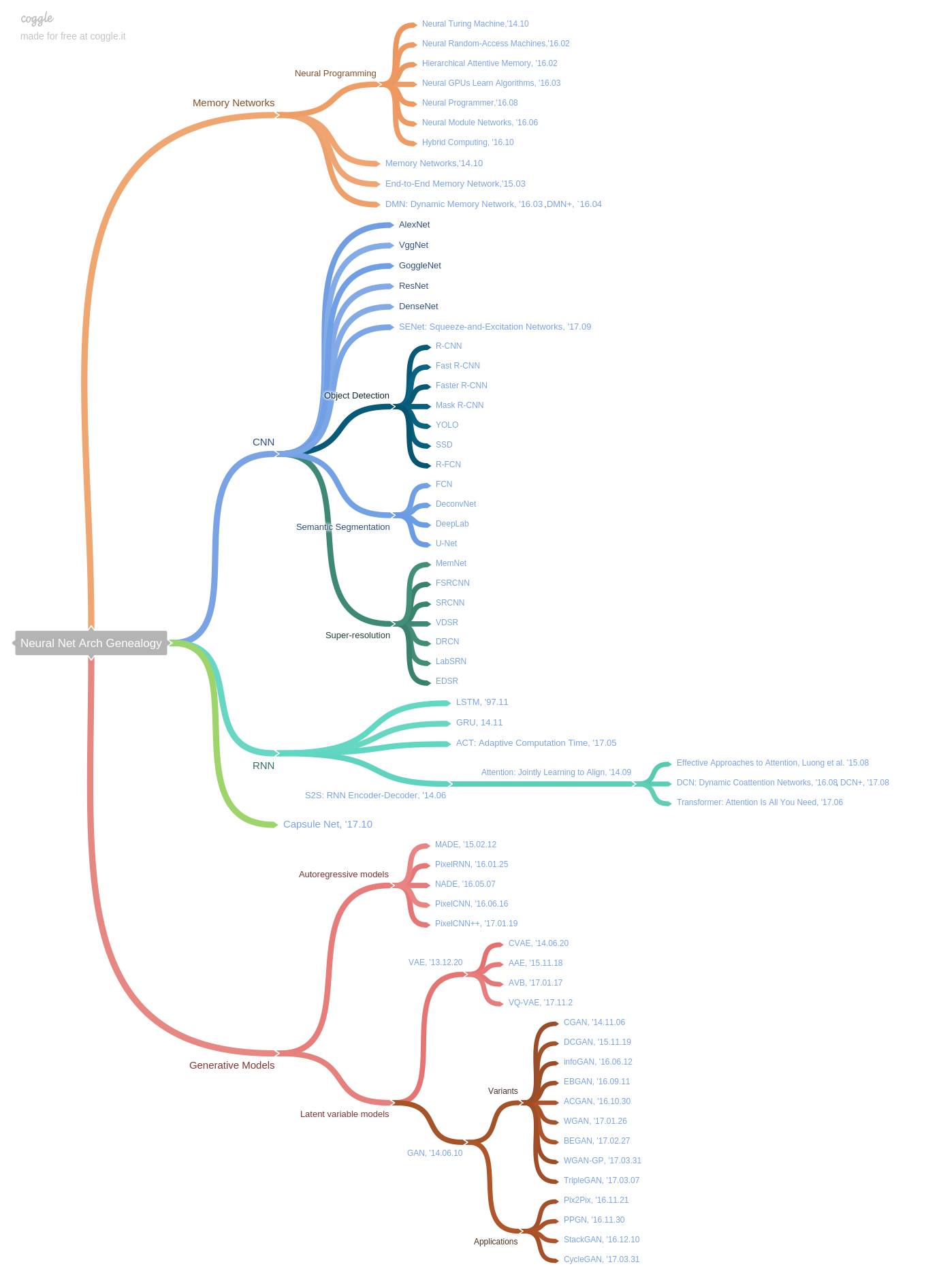

近幾年,深度學習高速發展,出現了大量的新模型與架構,以至于我們無法理清網絡類型之間的關系。在這篇文章中,香港科技大學(HKUST)助理教授金成勳總結了深度網絡類型之間的譜系圖,以便于我們索引不同類型網絡的杰出研究成果。

金成勳在 GitHub 上梳理出的譜系圖如下(點擊圖片放大查看),最后的藍色字體部分是各分支內的杰出研究成果(附所有論文鏈接)。機器之心在此基礎上對各個分支網絡做了介紹、補充,希望對讀者了解網絡體系間的關聯有所幫助。如有缺陷,歡迎大家留言補充。

Github 項目地址:https://github.com//hunkim/deep_architecture_genealogy

完整圖

記憶網絡

在記憶網絡分支中,hunkim 標注了三篇重要論文:《記憶網絡》、《端到端記憶網絡》、《DMN:動態記憶網絡》。神經編程是記憶網絡的下一級分支,包含神經圖靈機、混合計算等論文。

卷積神經網絡(CNN)

如下所示,CNN 除了包含執行目標識別任務的 AlexNet 等深度卷積網絡,還包括很多優秀的模型用于處理目標檢測、語義分割和超分辨率等任務。它們以不同的方式應用卷積過程處理不同的任務,并在這些任務上產生了非常好的效果。從基本上來說,卷積相對于最初的全連接網絡有很多優秀的屬性,例如它只和上一層神經元產生部分的連接,同一個卷積核可以在輸入張量上重復使用,也就是說特征檢測器可以在輸入圖像上重復檢測是否有該局部特征。這是卷積網絡十分優秀的屬性,它大大減少了兩層間參數的數量。

基于這些基礎的卷積特性,我們可以構建不同的卷積模型處理不同的任務。以下是卷積網絡的主要模型與領域:

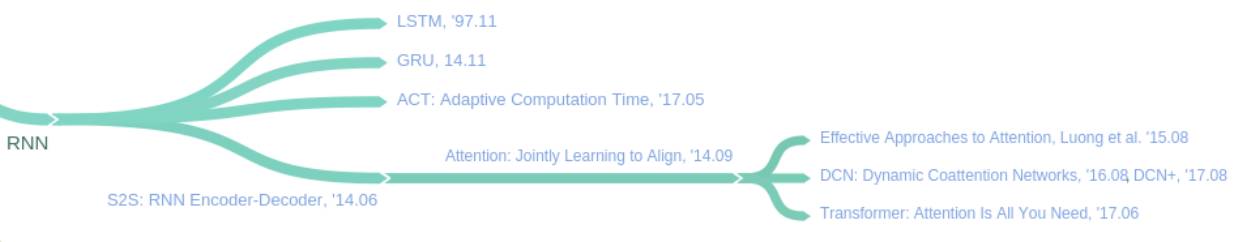

循環神經網絡(RNN)

循環神經網絡(recurrent neural network)是深度學習的重要組成部分,它可以讓神經網絡處理諸如文本、音頻和視頻等序列數據。它們可用來做序列的高層語義理解、序列標記,甚至可以從一個片段生產新的序列。目前有很多人工智能應用都依賴于循環深度神經網絡,在谷歌(語音搜索)、百度(DeepSpeech)和亞馬遜的產品中都能看到 RNN 的身影。

基本的 RNN 結構難以處理長序列,然而一種特殊的 RNN 變種即「長短時記憶(LSTM)」網絡可以很好地處理長序列問題。這種模型能力強大,在翻譯、語音識別和圖像描述等眾多任務中均取得里程碑式的效果。因而,循環神經網絡在最近幾年得到了廣泛使用。

Capsule Net

Capsule 是由深度學習先驅 Geoffrey Hinton 等人提出的新一代神經網絡形式,旨在修正反向傳播機制。在 Dynamic Routing Between Capsules 論文中,Geoffrey Hinton 這樣介紹 Capsule:「Capsule 是一組神經元,其輸入輸出向量表示特定實體類型的實例化參數(即特定物體、概念實體等出現的概率與某些屬性)。我們使用輸入輸出向量的長度表征實體存在的概率,向量的方向表示實例化參數(即實體的某些圖形屬性)。同一層級的 capsule 通過變換矩陣對更高級別的 capsule 的實例化參數進行預測。當多個預測一致時(本論文使用動態路由使預測一致),更高級別的 capsule 將變得活躍。」

Capsule 中神經元的激活情況表示了圖像中存在的特定實體的各種性質。這些性質可以包含多種不同的參數,例如姿勢(位置、大小、方向)、變形、速度、反射率、色彩、紋理等。而輸入輸出向量的長度表示了某個實體出現的概率,所以它的值必須在 0 到 1 之間。

機器之心也詳細解讀了上周 Hinton 公開的論文,這篇論文的亮點在于 Capsule 層的輸入與輸出都是向量,構建向量的過程可以認為是 PrimaryCaps 層利用 8 個標準的 Conv2D 操作產生一個長度為 8 個元素的向量,因此每一個 Capsule 單元就相當于 8 個卷積單元的組合。此外,在 Capsule 層中,Hinton 等人還使用了動態路由機制,這種更新耦合系數(coupling coef?cients)的方法并不需要使用反向傳播機制。

除了 Hinton 等人公布的 Capsule 論文以外,近日還有一篇 MATRIX CAPSULES WITH EM ROUTING 論文,該論文采用 EM Routing 修正原論文的 dynamic routing 從而實現更好的效果。

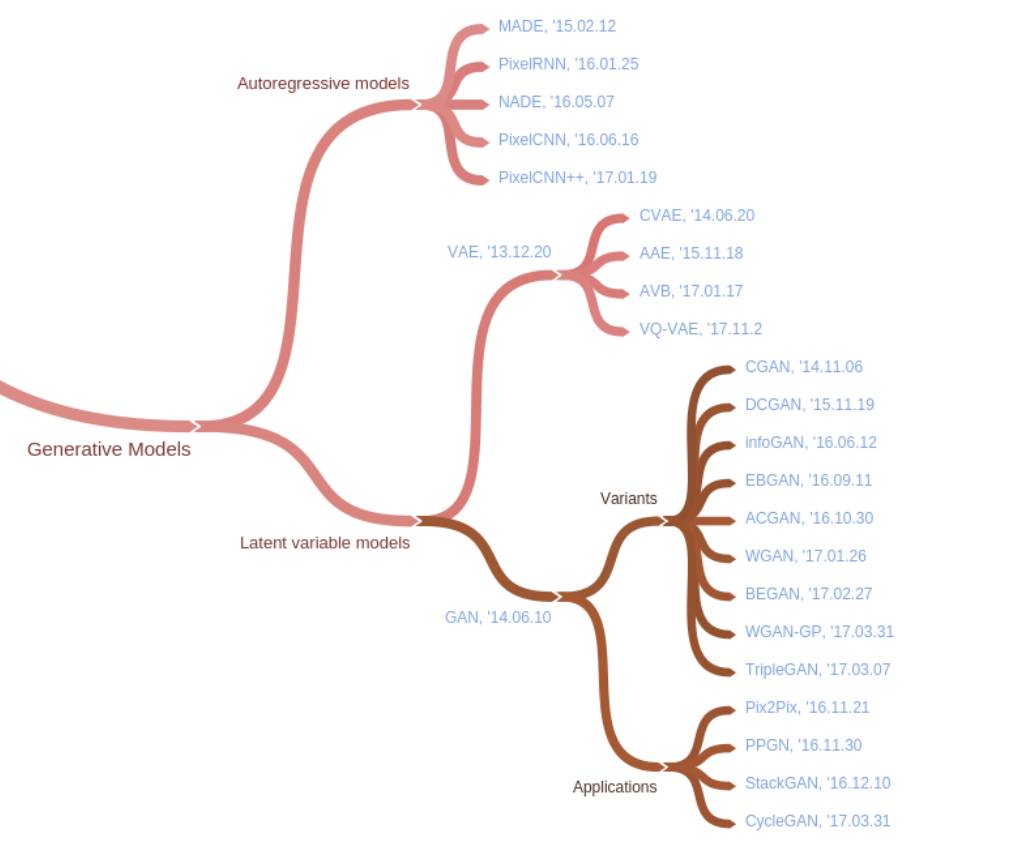

生成模型

人工智能研究的較大難題之一是無監督學習(unsupervised learning),而面向無監督學習的深度學習方法以學習表征(learning representation)問題為核心,不同的算法都會定義一個目標函數,該目標函數可以讓該學習器獲取到其數據表征的關鍵方面以及一個可以表征數據的新空間。深度生成模型可以通過生成全新的樣本來演示其對于數據的理解,盡管這些生成的樣本非常類似于那些訓練樣本。許多這樣的模型和之前的自編碼器的思想有關,其有一個編碼器函數將數據映射到表征,還有一個解碼器函數(或生成器)將該抽象的表征映射到原始數據空間。此外,生成模型很多也應用到了 GAN 的思想,即通過判別器與生成器之間的對抗促使生成器生成非常真實的圖像。

在變分自編碼器中,我們需要通過樣本訓練一個編碼器和解碼器,在這過程中我們能得到中間的隱藏變量。若我們需要生成新的圖像,那么只需要在隱藏變量采樣并投入解碼器就能完成生成。而在生成對抗網絡中,我們會定義一個判別模型與生成模型。首先我們會將生成的樣本混合真實樣本投遞給判別模型以訓練其鑒別真假的能力,隨后再固定判別模型并訓練生成模型,以生成更真實的圖像。

歡迎加入本站公開興趣群商業智能與數據分析群

興趣范圍包括各種讓數據產生價值的辦法,實際應用案例分享與討論,分析工具,ETL工具,數據倉庫,數據挖掘工具,報表系統等全方位知識

QQ群:81035754

文章版權歸作者所有,未經允許請勿轉載,若此文章存在違規行為,您可以聯系管理員刪除。

轉載請注明本文地址:http://m.specialneedsforspecialkids.com/yun/4654.html

摘要:根據上面這些原則,一個簡單的例子如下,省略了和可以輸入任何及子類的對象能確定返回的對象一定是或父類的對象只能確定返回的對象一定是選擇限定通配符時的快速判斷方法參考 showImg(https://segmentfault.com/img/bV4e7X?w=518&h=397); 當使用 的時候,可以當作

摘要:一個人的氣質里有走過的路讀過的書愛過的人又經歷了哪些故事呢引子一部高清電影秒秒鐘就能下載下來遠程游戲再也不會有卡頓和延遲的感覺了依托也出現了一系列的新東西,比如,車聯網自動駕駛遠程控制等等那從哪來的呢她經歷了怎樣的故事才走到如今的樣子本期將一個人的氣質里有走過的路、讀過的書、愛過的人5G 又經歷了哪些故事呢?引子一部高清電影 秒秒鐘 就能下載下來遠程游戲再也不會有卡頓和延遲的感覺了依托 5G...

閱讀 3391·2023-04-25 14:07

閱讀 3458·2021-09-28 09:35

閱讀 2091·2019-08-30 15:55

閱讀 1405·2019-08-30 13:48

閱讀 2502·2019-08-30 13:16

閱讀 3202·2019-08-30 12:54

閱讀 3238·2019-08-30 11:19

閱讀 1876·2019-08-29 17:17