資訊專欄INFORMATION COLUMN

摘要:本文依據(jù)對簡稱白皮書和官方教程的理解,從系統(tǒng)和代碼實現(xiàn)角度講解的內部實現(xiàn)原理。這一點是和包括在內的符號編程框架較大的不同。的做法是引入了來處理。這樣就幾乎讓本身成為一門獨立的語言。當為是,執(zhí)行操作當為時,執(zhí)行操作。支持的控制算子有和等。

摘要

2015年11月9日,Google發(fā)布深度學習框架TensorFlow并宣布開源,并迅速得到廣泛關注,在圖形分類、音頻處理、推薦系統(tǒng)和自然語言處理等場景下都被大面積推廣。TensorFlow系統(tǒng)更新快速,官方文檔教程齊全,上手快速且簡單易用,支持Python和C++接口。本文依據(jù)對Tensorflow(簡稱TF)白皮書[1]、TF Github[2]和TF官方教程[3]的理解,從系統(tǒng)和代碼實現(xiàn)角度講解TF的內部實現(xiàn)原理。以Tensorflow r0.8.0為基礎,本文由淺入深的闡述Tensor和Flow的概念。先介紹了TensorFlow的核心概念和基本概述,然后剖析了OpKernels模塊、Graph模塊、Session模塊。

1. TF系統(tǒng)架構

1.1 TF依賴視圖

TF的依賴視圖如圖 2 1所示[4],描述了TF的上下游關系鏈。

圖 1 1 TensorFlow依賴視圖

TF托管在github平臺,有google groups和contributors共同維護。

TF提供了豐富的深度學習相關的API,支持Python和C/C++接口。

TF提供了可視化分析工具Tensorboard,方便分析和調整模型。

TF支持Linux平臺,Windows平臺,Mac平臺,甚至手機移動設備等各種平臺。

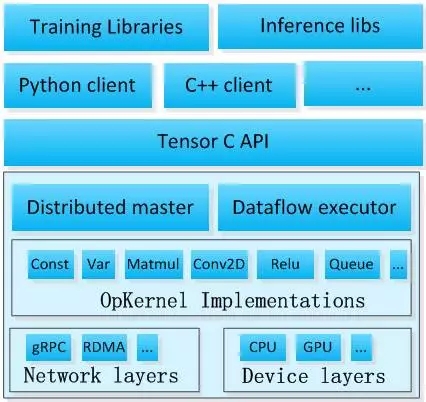

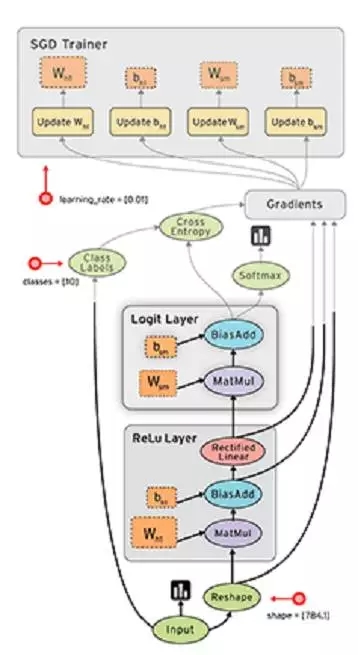

1.2 TF系統(tǒng)架構

圖 1 2是TF的系統(tǒng)架構,從底向上分為設備管理和通信層、數(shù)據(jù)操作層、圖計算層、API接口層、應用層。其中設備管理和通信層、數(shù)據(jù)操作層、圖計算層是TF的核心層。

圖 1 2 TF系統(tǒng)架構

底層設備通信層負責網(wǎng)絡通信和設備管理。設備管理可以實現(xiàn)TF設備異構的特性,支持CPU、GPU、Mobile等不同設備。網(wǎng)絡通信依賴gRPC通信協(xié)議實現(xiàn)不同設備間的數(shù)據(jù)傳輸和更新。

第二層是Tensor的OpKernels實現(xiàn)。這些OpKernels以Tensor為處理對象,依賴網(wǎng)絡通信和設備內存分配,實現(xiàn)了各種Tensor操作或計算。Opkernels不僅包含MatMul等計算操作,還包含Queue等非計算操作,這些將在第5章Kernels模塊詳細介紹。

第三層是圖計算層(Graph),包含本地計算流圖和分布式計算流圖的實現(xiàn)。Graph模塊包含Graph的創(chuàng)建、編譯、優(yōu)化和執(zhí)行等部分,Graph中每個節(jié)點都是OpKernels類型表示。關于圖計算將在第6章Graph模塊詳細介紹。

第四層是API接口層。Tensor C API是對TF功能模塊的接口封裝,便于其他語言平臺調用。

第四層以上是應用層。不同編程語言在應用層通過API接口層調用TF核心功能實現(xiàn)相關實驗和應用。

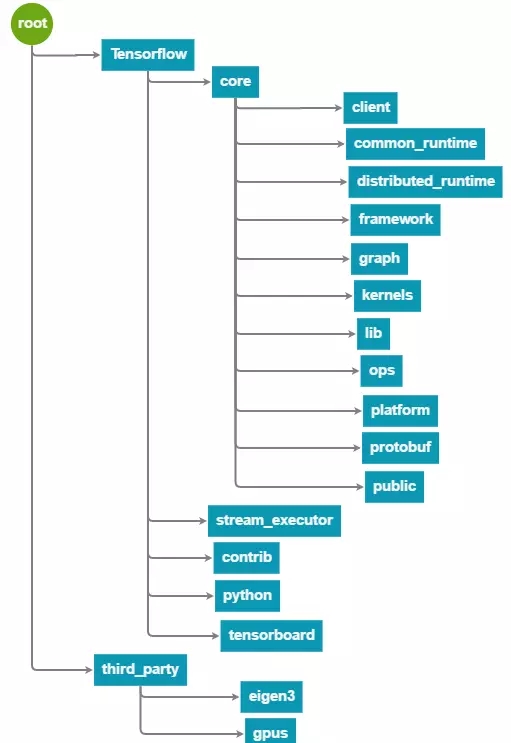

1.3TF代碼目錄組織

圖 1 3是TF的代碼結構視圖,下面將簡單介紹TF的目錄組織結構。

圖 1 3 TF代碼目錄組織結構

Tensorflow/core目錄包含了TF核心模塊代碼。

? ? ? ? public: API接口頭文件目錄,用于外部接口調用的API定義,主要是session.h 和tensor_c_api.h。

? ? ? ? client: API接口實現(xiàn)文件目錄。

? ? ? ? platform: OS系統(tǒng)相關接口文件,如file system, env等。

? ? ? ? protobuf: 均為.proto文件,用于數(shù)據(jù)傳輸時的結構序列化.

? ? ? ? common_runtime: 公共運行庫,包含session, executor, threadpool, rendezvous, memory管理, 設備分配算法等。

? ? ? ? distributed_runtime: 分布式執(zhí)行模塊,如rpc session, rpc master, rpc worker, graph manager。

? ? ? ? framework: 包含基礎功能模塊,如log, memory, tensor

? ? ? ? graph: 計算流圖相關操作,如construct, partition, optimize, execute等

? ? ? ? kernels: 核心Op,如matmul, conv2d, argmax, batch_norm等

? ? ? ? lib: 公共基礎庫,如gif、gtl(google模板庫)、hash、histogram等。

? ? ? ? ops: 基本ops運算,ops梯度運算,io相關的ops,控制流和數(shù)據(jù)流操作

? ? ? ? Tensorflow/stream_executor目錄是并行計算框架,由google stream executor團隊開發(fā)。

? ? ? ? Tensorflow/contrib目錄是contributor開發(fā)目錄。

? ? ? ? Tensroflow/python目錄是python API客戶端腳本。

? ? ? ?Tensorflow/tensorboard目錄是可視化分析工具,不僅可以模型可視化,還可以監(jiān)控模型參數(shù)變化。

? ? ? ? third_party目錄是TF第三方依賴庫。

? ? ? ? eigen3: eigen矩陣運算庫,TF基礎ops調用

? ? ? ? gpus: 封裝了cuda/cudnn編程庫

2. TF核心概念

TF的核心是圍繞Graph展開的,簡而言之,就是Tensor沿著Graph傳遞閉包完成Flow的過程。所以在介紹Graph之前需要講述一下符號編程、計算流圖、梯度計算、控制流的概念。

2.1 Tensor

在數(shù)學上,Matrix表示二維線性映射,Tensor表示多維線性映射,Tensor是對Matrix的泛化,可以表示1-dim、2-dim、N-dim的高維空間。圖 2 1對比了矩陣乘法(Matrix Product)和張量積(Tensor Contract),可以看出Tensor的泛化能力,其中張量積運算在TF的MatMul和Conv2D運算中都有用到,

圖 2 1 Tensor contract

Tensor在高維空間數(shù)學運算比Matrix計算復雜,計算量也非常大,加速張量并行運算是TF優(yōu)先考慮的問題,如add, contract, slice, reshape, reduce, shuffle等運算。

TF中Tensor的維數(shù)描述為階,數(shù)值是0階,向量是1階,矩陣是2階,以此類推,可以表示n階高維數(shù)據(jù)。

TF中Tensor支持的數(shù)據(jù)類型有很多,如tf.float16, tf.float32, tf.float64, tf.uint8, tf.int8, tf.int16, tf.int32, tf.int64, tf.string, tf.bool, tf.complex64等,所有Tensor運算都使用泛化的數(shù)據(jù)類型表示。

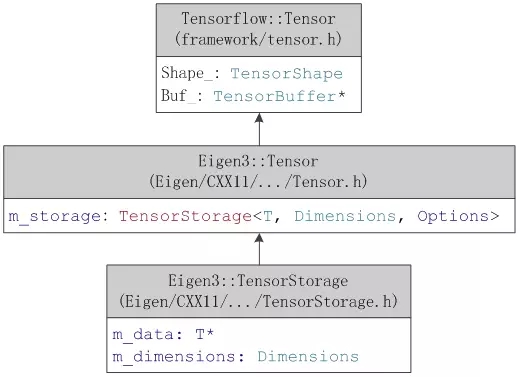

TF的Tensor定義和運算主要是調用Eigen矩陣計算庫完成的。TF中Tensor的UML定義如圖 2 2。其中TensorBuffer指針指向Eigen::Tensor類型。其中,Eigen::Tensor[5][6]不屬于Eigen官方維護的程序,由貢獻者提供文檔和維護,所以Tensor定義在Eigen unsupported模塊中。

圖 2 2 Tensor數(shù)據(jù)結構定義

圖 2 2中,Tensor主要包含兩個變量m_data和m_dimension,m_data保存了Tensor的數(shù)據(jù)塊,T是泛化的數(shù)據(jù)類型,m_dimensions保存了Tensor的維度信息。

Eigen::Tensor的成員變量很簡單,卻支持非常多的基本運算,再借助Eigen的加速機制實現(xiàn)快速計算,參考章節(jié)3.2。Eigen::Tensor主要包含了

? ? ? ?一元運算(Unary),如sqrt、square、exp、abs等。

? ? ? ?二元運算(Binary),如add,sub,mul,div等

? ? ? ?選擇運算(Selection),即if / else條件運算

? ? ? ?歸納運算(Reduce),如reduce_sum, reduce_mean等

? ? ? ?幾何運算(Geometry),如reshape,slice,shuffle,chip,reverse,pad,concatenate,extract_patches,extract_image_patches等

? ? ? ?張量積(Contract)和卷積運算(Convolve)是重點運算,后續(xù)會詳細講解。

2.2 符號編程

編程模式通常分為命令式編程(imperative style programs)和符號式編程(symbolic style programs)。

命令式編程容易理解和調試,命令語句基本沒有優(yōu)化,按原有邏輯執(zhí)行。符號式編程涉及較多的嵌入和優(yōu)化,不容易理解和調試,但運行速度有同比提升。

這兩種編程模式在實際中都有應用,Torch是典型的命令式風格,caffe、theano、mxnet和Tensorflow都使用了符號式編程。其中caffe、mxnet采用了兩種編程模式混合的方法,而Tensorflow是完全采用了符號式編程,Theano和Tensorflow的編程模式更相近。

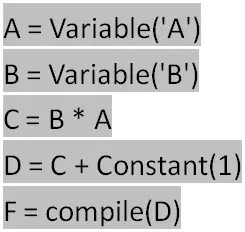

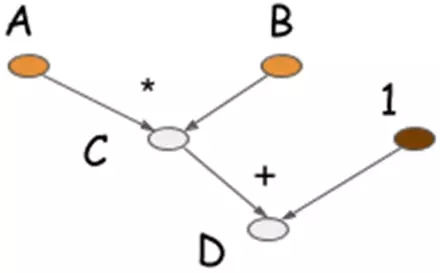

命令式編程是常見的編程模式,編程語言如python/C++都采用命令式編程。命令式編程明確輸入變量,并根據(jù)程序邏輯逐步運算,這種模式非常在調試程序時進行單步跟蹤,分析中間變量。舉例來說,設A=10, B=10,計算邏輯:

第一步計算得出C=100,第二步計算得出D=101,輸出結果D=101。

符號式編程將計算過程抽象為計算圖,計算流圖可以方便的描述計算過程,所有輸入節(jié)點、運算節(jié)點、輸出節(jié)點均符號化處理。計算圖通過建立輸入節(jié)點到輸出節(jié)點的傳遞閉包,從輸入節(jié)點出發(fā),沿著傳遞閉包完成數(shù)值計算和數(shù)據(jù)流動,直到達到輸出節(jié)點。這個過程經(jīng)過計算圖優(yōu)化,以數(shù)據(jù)(計算)流方式完成,節(jié)省內存空間使用,計算速度快,但不適合程序調試,通常不用于編程語言中。舉上面的例子,先根據(jù)計算邏輯編寫符號式程序并生成計算圖

其中A和B是輸入符號變量,C和D是運算符號變量,compile函數(shù)生成計算圖F,如圖 2 3所示。

圖 2 3 符號編程的正向計算圖

最后得到A=10, B=10時變量D的值,這里D可以復用C的內存空間,省去了中間變量的空間存儲。

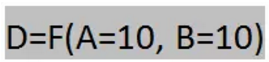

圖 2 4是TF中的計算流圖,C=F(Relu(Add(MatMul(W, x), b))),其中每個節(jié)點都是符號化表示的。通過session創(chuàng)建graph,在調用session.run執(zhí)行計算。

圖 2 4 TF符號計算圖

和目前的符號語言比起來,TF較大的特點是強化了數(shù)據(jù)流圖,引入了mutation的概念。這一點是TF和包括Theano在內的符號編程框架較大的不同。所謂mutation,就是可以在計算的過程更改一個變量的值,而這個變量在計算的過程中會被帶入到下一輪迭代里面去。

Mutation是機器學習優(yōu)化算法幾乎必須要引入的東西(雖然也可以通過immutable replacement來代替,但是會有效率的問題)。 Theano的做法是引入了update statement來處理mutation。TF選擇了純符號計算的路線,并且直接把更新引入了數(shù)據(jù)流圖中去。從目前的白皮書看還會支持條件和循環(huán)。這樣就幾乎讓TF本身成為一門獨立的語言。不過這一點會導致最后的API設計和使用需要特別小心,把mutation 引入到數(shù)據(jù)流圖中會帶來一些新的問題,比如如何處理寫與寫之間的依賴。[7]

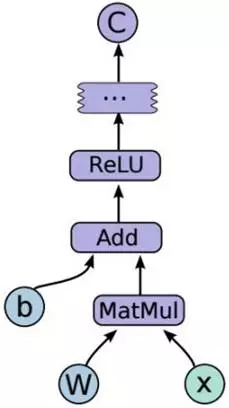

2.3 梯度計算

梯度計算主要應用在誤差反向傳播和數(shù)據(jù)更新,是深度學習平臺要解決的核心問題。梯度計算涉及每個計算節(jié)點,每個自定義的前向計算圖都包含一個隱式的反向計算圖。從數(shù)據(jù)流向上看,正向計算圖是數(shù)據(jù)從輸入節(jié)點到輸出節(jié)點的流向過程,反向計算圖是數(shù)據(jù)從輸出節(jié)點到輸入節(jié)點的流向過程。

圖 2 5是2.2節(jié)中圖 2 3對應的反向計算圖。圖中,由于C=A*B,則dA=B*dC, dB=A*dC。在反向計算圖中,輸入節(jié)點dD,輸出節(jié)點dA和dB,計算表達式為dA=B*dC=B*dD, dB=A*dC=A*dD。每一個正向計算節(jié)點對應一個隱式梯度計算節(jié)點。

圖 2 5 符號編程的反向計算圖

反向計算限制了符號編程中內存空間復用的優(yōu)勢,因為在正向計算中的計算數(shù)據(jù)在反向計算中也可能要用到。從這一點上講,粗粒度的計算節(jié)點比細粒度的計算節(jié)點更有優(yōu)勢,而TF大部分為細粒度操作,雖然靈活性很強,但細粒度操作涉及到更多的優(yōu)化方案,在工程實現(xiàn)上開銷較大,不及粗粒度簡單直接。在神經(jīng)網(wǎng)絡模型中,TF將逐步側重粗粒度運算。

2.4 控制流

TF的計算圖如同數(shù)據(jù)流一樣,數(shù)據(jù)流向表示計算過程,如圖 2 6。數(shù)據(jù)流圖可以很好的表達計算過程,為了擴展TF的表達能力,TF中引入控制流。

圖 2 6 Graph的數(shù)據(jù)流

在編程語言中,if…else…是最常見的邏輯控制,在TF的數(shù)據(jù)流中也可以通過這種方式控制數(shù)據(jù)流向。接口函數(shù)如下,pred為判別表達式,fn1和fn2為運算表達式。當pred為true是,執(zhí)行fn1操作;當pred為false時,執(zhí)行fn2操作。

TF還可以協(xié)調多個數(shù)據(jù)流,在存在依賴節(jié)點的場景下非常有用,例如節(jié)點B要讀取模型參數(shù)θ更新后的值,而節(jié)點A負責更新參數(shù)θ,則節(jié)點B必須等節(jié)點A完成后才能執(zhí)行,否則讀取的參數(shù)θ為更新前的數(shù)值,這時需要一個運算控制器。接口函數(shù)如下,tf.control_dependencies函數(shù)可以控制多個數(shù)據(jù)流執(zhí)行完成后才能執(zhí)行接下來的操作,通常與tf.group函數(shù)結合使用。

TF支持的控制算子有Switch、Merge、Enter、Leave和NextIteration等。

TF不僅支持邏輯控制,還支持循環(huán)控制。TF使用和MIT Token-Tagged machine相似的表示系統(tǒng),將循環(huán)的每次迭代標記為一個tag,迭代的執(zhí)行狀態(tài)標記為一個frame,但迭代所需的數(shù)據(jù)準備好的時候,就可以開始計算,從而多個迭代可以同時執(zhí)行。

作者簡介:

姚健,畢業(yè)于中科院計算所網(wǎng)絡數(shù)據(jù)實驗室,畢業(yè)后就職于360天眼實驗室,主要從事深度學習和增強學習相關研究工作。目前就職于騰訊MIG事業(yè)部,從事神經(jīng)機器翻譯工作。聯(lián)系方式: yao_62995@163.com

歡迎加入本站公開興趣群商業(yè)智能與數(shù)據(jù)分析群

興趣范圍包括各種讓數(shù)據(jù)產生價值的辦法,實際應用案例分享與討論,分析工具,ETL工具,數(shù)據(jù)倉庫,數(shù)據(jù)挖掘工具,報表系統(tǒng)等全方位知識

QQ群:81035754

文章版權歸作者所有,未經(jīng)允許請勿轉載,若此文章存在違規(guī)行為,您可以聯(lián)系管理員刪除。

轉載請注明本文地址:http://m.specialneedsforspecialkids.com/yun/4470.html

摘要:據(jù)公告稱,和的包裝庫使用了不安全的函數(shù)來反序列化編碼的機器學習模型。簡單來看,序列化將對象轉換為字節(jié)流。據(jù)悉,本次漏洞影響與版本,的到版本均受影響。作為解決方案,在宣布棄用之后,團隊建議開發(fā)者以替代序列化,或使用序列化作為替代。 ...

閱讀 2067·2021-11-11 16:55

閱讀 1401·2021-09-28 09:36

閱讀 1047·2019-08-29 15:21

閱讀 1578·2019-08-29 14:10

閱讀 2764·2019-08-29 14:08

閱讀 1638·2019-08-29 12:31

閱讀 3251·2019-08-29 12:31

閱讀 983·2019-08-26 16:47