資訊專欄INFORMATION COLUMN

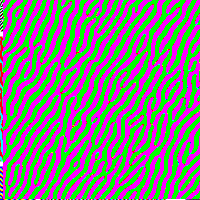

摘要:在較低水平的神經元中,一個多樣性術語可以揭示一個特征所代表的不同方面簡單優化用多樣性進行的優化揭示了四個不同的彎曲的方面。注意勺子的紋理和顏色與狗的皮毛相似,從而足以讓神經元激活。下面,一個神經元對兩種類型的動物臉部以及車做出響應。

邊緣(層 conv2d0)

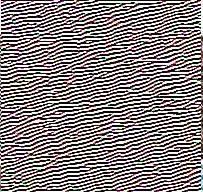

紋理(層 mixed3a)

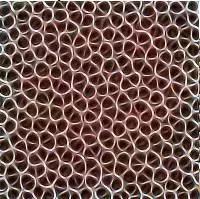

模式(層 mixed4a)

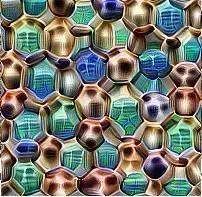

部分(層 mixed4b & mixed4c)

目標(層 mixed4d & mixed4e)

特征可視化使我們能夠看到在ImageNet數據集上訓練的GoogLeNet是如何構建對多層圖像的理解的。所有信道的可視化可以在appendix上查到(https://distill.pub/2017/feature-visualization/appendix/)。

現如今,人們越來越意識到,神經網絡對于人類來說應該是具有可解釋性的。針對這些問題,神經網絡的可解釋性領域已經形成,并隨著發展的成熟,兩大研究思路已經開始走向融合:特征可視化和屬性。

?

特征可視化通過生成樣本來回答有關網絡或部分網絡所正在尋找什么的問題。

屬性(attribution)研究的是一個樣本中的哪一部分負責以特定的方式所激活的網絡。

(注:作為一個新興的領域,神經網絡的互操作性還沒有標準化的術語。屬性(attribution)在文獻中已經有許多不同的名稱—包括“特征可視化”—但近期的工作似乎更傾向“屬性”和“顯著圖(saliency maps)”)

本文重點介紹特征可視化。雖然特征可視化是一個強大的工具,但實際上它的工作涉及到許多細節。在本文中,我們將研究主要問題并探討解決這些問題的常用方法。我們發現,非常簡單的方法可以產生高質量的可視化效果。而在這個過程中,我們將引入一些技巧,以探索在神經元反應中的變體,它們是如何相互作用,以及該如何改進優化過程的。

通過優化進行特征可視化

一般而言,神經網絡在輸入方面是可微的。如果我們想要找出哪種輸入會導致某種行為——無論是內部神經元還是最終輸出行為——我們都可以使用導數來迭代地調整輸入以實現該目標。

從隨機噪聲開始,我們優化一個圖像以激活一個特定的神經元。

雖然從概念上看很簡單,但在優化工作方面還存在著微妙的挑戰。我們將對其進行探索,并挖掘它們的幾種常見方法。

優化目標

我們想要什么樣的樣本?這是處理樣本的核心問題,無論我們是通過搜索數據集來查找樣本還是優化圖像以從頭開始創建。可以說,我們在搜索方面有很多種選擇:

不同的優化目標顯示網絡的不同部分正在尋找。

n:層索引

x,y:空間位置

z:信道索引

K:類指數

神經元

layern[x,y,z]

信道

layern[:,:,z]

?

層/ DeepDream

layern[:,:,:]2

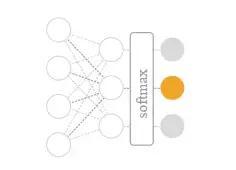

類對數

pre_softmax[k]

?

類概率

softmax[k]

如果我們想了解單個特征,我們可以搜索那些具有高值的樣本——無論是位于某個單一位置還是整個信道的神經元。我們使用信道目標來創建本文中的大部分圖像。

如果我們想要將層作為一個整體來了解,我們可以使用DeepDream目標,搜索層以發現有用的圖像。

如果我們想從一個分類器中創建輸出類的樣本,我們有兩個選擇——在softmax之前優化類對數,或者在softmax之后優化類概率。我們可以把這些對數視作每個類證據,把概率作為每個給定證據的類的似然值。不幸的是,用來增加softmax函數給予類概率的最簡單的方法往往使替代方案不太可能實現,而不是使有用的類成為可能。根據我們的經驗,優化前softmax對數會生成具有更好視覺質量的圖像。

我們提到的目標僅僅涉及的是可能存在的目標的表面,還有更多的可以去嘗試。特別值得注意的是在風格遷移中所使用的目標,它可以告訴我們關于網絡所能理解的風格和內容的種類,以及基于優化的模型倒置中所使用的目標,而這有助于我們理解模型所保存和丟棄的信息。我們所涉及的不過是一些簡單的知識,要探索的空間還很大。

為什么通過優化進行可視化

優化可以為我們提供一個樣本輸入,從而產生期望行為。但為什么要如此大費周章呢?難道我們不能通過數據集查找可以產生期望行為的樣本嗎?

事實證明,優化方法可以成為理解模型真正在尋找什么的強大方法,因為它將把產生行為的事物與那些僅與事件相關的事物區分開來。例如,考慮以下使用數據集樣本和優化進行可視化的神經元:

優化還具有靈活性的優勢。例如,如果我們想研究神經元是如何共同地來表征信息的,我們可以很容易地去問一個特定的樣本將需要變得如何不同,從而可以激活一個附加的神經元。這種靈活性還可以幫助可視化網絡訓練中的特征演變。如果我們僅限于理解數據集中固定樣本的模型,那么像這些類似的主題將更變得難以探索。

另一方面,通過優化對特征進行可視化也是一個巨大的挑戰。在下面的章節中,我們將研究獲得多樣化可視化的技術,從而了解神經元是如何相互作用的。

多樣性

我們的樣本是否向我們展示了全貌?當我們通過優化來創建樣本時,這一點是需要非常注意的。真正的樣本可以僅向我們展示一個特征所代表的“小平面(facet)”來誤導我們。

數據集樣本在這里有很大的優勢。通過查看數據集,我們可以找到不同的樣本。它不只是為我們激活了一個神經元:我們可以看到整個激活范圍,從而看看到底是什么激活了神經元的不同區段。

相比之下,優化通常只能給我們一個非常正向的樣本,當然,如果我們有創造力的話,那么即使是一個非常負向的樣本也是可以的。有沒有什么方法可以使我們獲得這種多樣性?

通過優化實現多樣性

網絡的一個給定特征可以對廣泛的輸入作出響應。例如,在類等級上,經過訓練的識別狗的分類器應該能夠識別它們的臉部特寫以及更寬的輪廓圖像——盡管這些圖像具有完全不同的視覺外觀。Wei等人的早期研究試圖通過在整個訓練集上記錄激活來展示這種“內部類(intra-class)”多樣性,對它們進行聚類并對集群中心進行優化,從而揭示出所學習類的不同方面。

Nguyen、Yosinski及其合作者所采用的另一種方法是在數據集中搜索不同的樣本,并將其作為優化過程的起始點。這個想法是,在特征的不同方面進行優化,從而從優化中得到的樣本將能夠對這些方面進行演示。在最近的研究中,他們把可視化類和生成式模型結合起來,即可以對不同的樣本進行采樣。他們的第一種方法的成功是有局限性的,而生成式模型的方法運行地很好。

我們發現,實現多樣性有一個非常簡單的方法:在一個目標上增加一個“多樣性術語”,這個目標就是推動多個樣本彼此互不相同。多樣性術語可以采取多種形式。現如今,我們對它們的好處還不太了解。一種可能是,對不同樣本的余弦相似度進行懲罰。另一種方法是使用風格遷移中的思想,迫使該特征以不同的風格得以顯示。

在較低水平的神經元中,一個多樣性術語可以揭示一個特征所代表的不同方面:

?

簡單優化

用多樣性進行的優化揭示了四個不同的、彎曲的方面。

?

數據集樣本

不同的特征可視化使得我們能夠更較精確地確定是什么激活了神經元,以及我們可以做出的程度,并且通過查看數據集樣本,做出有關哪些輸入將激活神經元的預測。

例如,讓我們來看看這個簡單的優化結果。

?

只是獨立地看一下,我們可能會推斷出在狗頭頂部的這個神經元被激活,因為優化顯示了眼睛和只有向下彎曲的邊緣。然而,從多樣性的優化來看,我們看到了不包括眼睛的優化結果,以及一個包含向上彎曲邊緣的優化結果。因此,我們不得不擴大我們對這個神經元激活的期望,主要是關于毛皮紋理。根據數據集樣本來檢查這個假設,結果顯示,這是大致正確的。 注意勺子的紋理和顏色與狗的皮毛相似,從而足以讓神經元激活。

簡單優化

用多樣性進行的優化

數據集樣本

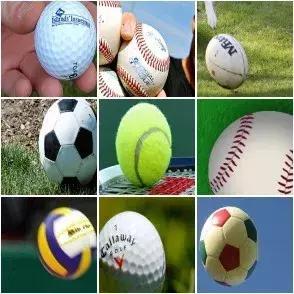

在更高水平的神經元中,多樣性的影響可能更加顯著,其中,它可以向我們展示能夠刺激神經元的不同類型的物體。例如,一個神經元能夠對不同類型的球做出響應,即使它們具有各種各樣的外觀。

簡單優化

多樣性優化揭示了多種類型的球

?

數據集樣本

不過,這個更為簡單的方法有一些缺點:例如,為了使樣本不同造成的壓力會導致無關的部分(如眼睛)出現。此外,優化可能會使樣本以一種不自然的方式展示。例如,在上面的樣本中,人們可能希望看到足球這樣的樣本與高爾夫球或網球等其他類型球有清晰的分離。如Wei等人提出的諸如基于數據集的方法可以更為自然地將特征分離開來,但是它們可能不會有助于理解模型在不同數據上的表現。

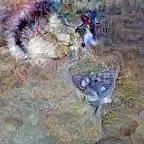

與此同時,多樣性也開始呈現出一個更為基本的問題:雖然上面的樣本代表了一個大體上一致的想法,但也有一些神經元代表的是一些奇怪想法的混合。下面,一個神經元對兩種類型的動物臉部、以及車做出響應。

?

簡單優化

用多樣性優化顯示出貓、狐貍、以及汽車

數據集樣本

像這樣的樣本表明,神經元不一定是理解神經網絡的正確的語義單元。

神經元之間的相互作用

如果神經元不是了解神經網絡的正確方法,那什么是呢?在現實生活中,神經元組合在一起來運行以表示神經網絡中的圖像。單個神經元是激活空間的基本方向,目前并不清楚這些應該比任何其他方向更為特殊。

Szegedy等人發現隨機方向看起來和基礎方向一樣有意義。最近Bau、Zhou等人發現基礎方向比隨機方向更加具有可解釋性。我們的經驗與這兩個結果大體一致。我們發現,隨機方向似乎更加具有可解釋性,但要比基本方向的速度要低。

特征可視化的敵人

如果你想要把特征可視化,你可能只是在優化圖像,從而使得神經元得以激活。不幸的是,這并不是真的有效。相反,最終會出現一種神經網絡的視覺錯覺——一種充滿噪聲且無意義的高頻模式的圖像,而且是網絡會進行強烈響應的。

這些模式似乎是一種帶有欺騙性的圖像,其實,在現實生活中并不會發行尋找方法以激活神經元的現象。如果你進行優化的時間足夠長,你就會看到神經元真正檢測到的東西是什么,但是圖像是由這些高頻模式所支配的。這些模式似乎與敵對的樣本現象密切相關。

結論

在過去的幾年里,神經特征可視化取得了巨大的進步。作為一個社區,我們已經制定了原則性的方法來創建令人信服的可視化。我們已經發現了一些重要的挑戰,并找到了解決這些問題的方法。

在使神經網絡具有可解釋性的過程中,特征可視化是最具發展前景的方向之一。從它本身可以看出,特征可視化永遠不會給人一種完全令人滿意的理解。我們認為它是一個基本的構建塊,通過與其他工具相結合,從而使人類能夠理解這些系統。

在提高特征可視化方面,還有許多重要的研究要做。一些突出的問題包括理解神經元的相互作用,找出哪些單元在理解神經網絡的激活中最具有意義,并給出一個特征的各個方面的整體視圖。

歡迎加入本站公開興趣群商業智能與數據分析群

興趣范圍包括各種讓數據產生價值的辦法,實際應用案例分享與討論,分析工具,ETL工具,數據倉庫,數據挖掘工具,報表系統等全方位知識

QQ群:81035754

文章版權歸作者所有,未經允許請勿轉載,若此文章存在違規行為,您可以聯系管理員刪除。

轉載請注明本文地址:http://m.specialneedsforspecialkids.com/yun/4652.html

摘要:要理解網絡中的單個特征,比如特定位置的某個神經元或者一整個通道,就可以找讓這個特征產生很高的值的樣本。另一方面,也能看到一些神經元同時對多個沒什么關系的概念產生響應。實際操作經驗中,我們也認為是一組神經元的組合共同表征了一張圖像。 深度神經網絡解釋性不好的問題一直是所有研究人員和商業應用方案上方懸著的一團烏云,現代CNN網絡固然有強大的特征抽取能力,但沒有完善的理論可以描述這個抽取過程的本質...

摘要:從到,計算機視覺領域和卷積神經網絡每一次發展,都伴隨著代表性架構取得歷史性的成績。在這篇文章中,我們將總結計算機視覺和卷積神經網絡領域的重要進展,重點介紹過去年發表的重要論文并討論它們為什么重要。這個表現不用說震驚了整個計算機視覺界。 從AlexNet到ResNet,計算機視覺領域和卷積神經網絡(CNN)每一次發展,都伴隨著代表性架構取得歷史性的成績。作者回顧計算機視覺和CNN過去5年,總結...

摘要:深度學習架構清單現在我們明白了什么是高級架構,并探討了計算機視覺的任務分類,現在讓我們列舉并描述一下最重要的深度學習架構吧。是較早的深度架構,它由深度學習先驅及其同僚共同引入。這種巨大的差距由一種名為的特殊結構引起。 時刻跟上深度學習領域的進展變的越來越難,幾乎每一天都有創新或新應用。但是,大多數進展隱藏在大量發表的 ArXiv / Springer 研究論文中。為了時刻了解動態,我們創建了...

摘要:誕生于年,是最早的卷積神經網絡之一,并且推動了深度學習領域的發展。間隔從年到年神經網絡處于孵化階段。與來自谷歌的開始追求減少深度神經網絡的計算開銷,并設計出第一個架構參見。 LeNet5LeNet5 誕生于 1994 年,是最早的卷積神經網絡之一,并且推動了深度學習領域的發展。自從 1988 年開始,在許多次成功的迭代后,這項由 Yann LeCun 完成的開拓性成果被命名為 LeNet5(...

摘要:年,發表,至今,深度學習已經發展了十幾年了。年的結構圖圖片來自于論文基于圖像識別的深度卷積神經網絡這篇文章被稱為深度學習的開山之作。還首次提出了使用降層和數據增強來解決過度匹配的問題,對于誤差率的降低至關重要。 1998年,Yann LeCun 發表Gradient-Based Learning Applied to Document Recognition,至今,深度學習已經發展了十幾年了...

閱讀 3647·2021-11-25 09:43

閱讀 646·2021-09-22 15:59

閱讀 1750·2021-09-06 15:00

閱讀 1775·2021-09-02 09:54

閱讀 694·2019-08-30 15:56

閱讀 1185·2019-08-29 17:14

閱讀 1845·2019-08-29 13:15

閱讀 886·2019-08-28 18:28