資訊專欄INFORMATION COLUMN

摘要:膠囊網絡是一種熱門的新型神經網絡架構,它可能會對深度學習特別是計算機視覺領域產生深遠的影響。下幾層膠囊也嘗試檢測對象及其姿態,但工作方式非常不同,即使用按協議路由算法。

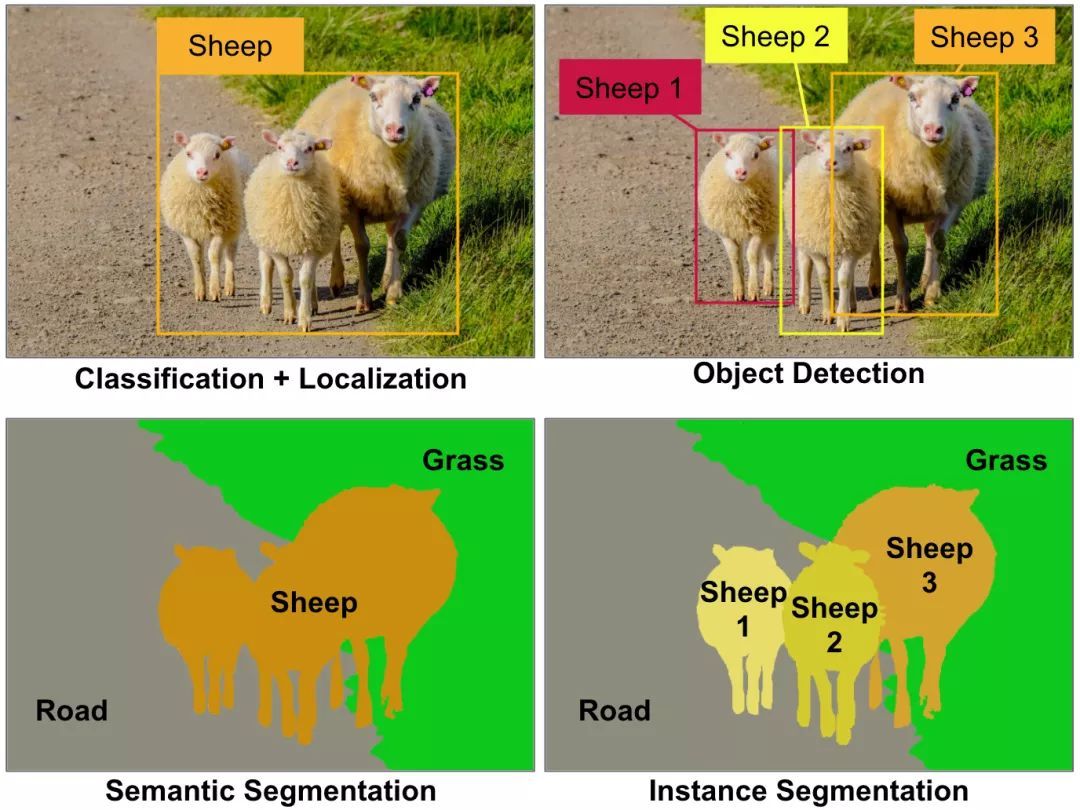

膠囊網絡(Capsule networks, CapsNets)是一種熱門的新型神經網絡架構,它可能會對深度學習特別是計算機視覺領域產生深遠的影響。等一下,難道計算機視覺問題還沒有被很好地解決嗎?卷積神經網絡(Convolutional neural networks, CNNs)已在分類、定位、物體檢測、語義分割或實例分割等各種計算機視覺任務中達到了超人類水平,難道我們所有人沒有注意到這些難以置信的例子嗎?(見圖1)

圖1 一些主要的計算機視覺任務。現今,這些計算機視覺任務都需要不同的卷積神經網絡架構,如用于分類的ResNet架構,用于目標檢測的YOLO架構,用于語義分析的掩模R-CNN架構,等等。圖像由AurélienGéron提供。

是的,我們已經看到了令人難以置信的CNNs,但是:

這些CNNs都接受了數量巨大圖像的訓練(或重復使用了部分已訓練過的神經網絡)。CapsNets能通過少得多的訓練數據就可很好地完成網絡訓練。

CNNs不能很好地處理圖像多義性表達。而膠囊網絡可以很好處理這一問題,即使在擁擠的場景下也表現出色(盡管CapsNets現在仍與背景糾纏在一起)。

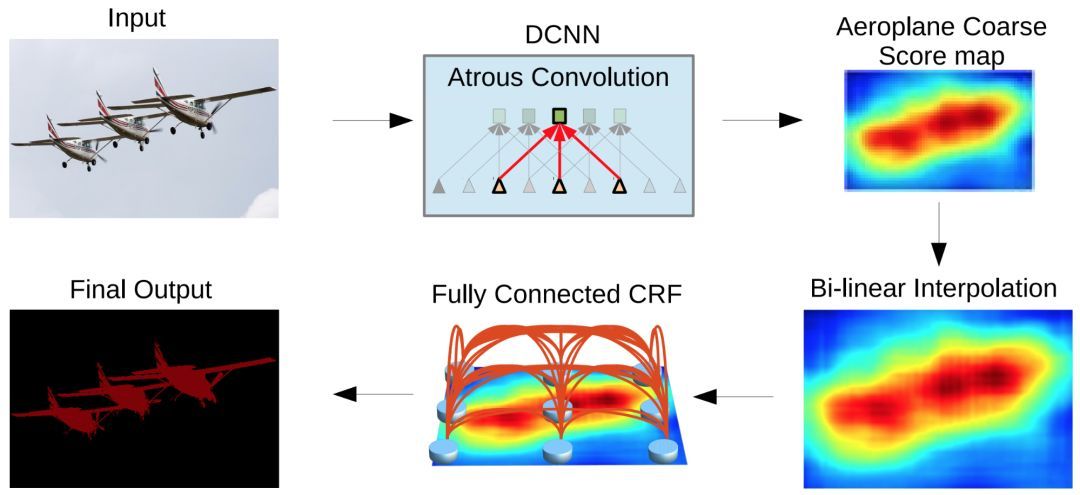

CNNs在池化層丟失大量信息。這些池化層降低了圖像空間分辨率(見圖2),為此,它們的輸出對輸入端的微小變化是保持不變的。當整個網絡中細節信息必須被保留時,這就是一個問題,如在語義分割中。目前,解決這個問題主要是通過在CNNs周圍構建復雜結構來恢復一些丟失的信息。運用CapsNets,詳細的姿態信息(如較精確的目標位置、旋轉、厚度、歪斜、大小等等)在整個網絡中都被保留,而不是丟失而后被恢復過來。輸入的微小變化會導致輸出的細微變化——信息卻被保留。這就是所謂的“同變性(equivariance)”。所以,CapsNets對于不同的視覺任務可以使用相同的簡單且一致的架構。

最后,CNNs需要額外的組件來實現自動識別一個部件歸屬于哪一個對象(如,這條腿屬于這只羊)。而CapsNets則免費提供部件的層次結構。

圖2 DeepLab2圖像分割流程,由Liang-Chieh Chen等提供:可以看到,CNN(右上)的輸出結果是十分粗糙的,這使得通過增加額外步驟來恢復丟失的細節很有必要。該圖來自Deeplab論文《Semantic Image Segmentation with Deep Convolutional Nets, Atrous Convolution,and Fully Connected CRFs》,引用得到作者許可。想了解語義分割體系結構的多樣性和復雜性可以看S. Chilamkurthy所做的這篇好文章。

CapsNets是由Geoffrey Hinton等人于2011年在一篇名為“轉換自動編碼器(Transforming Autoencoders)”論文中首次提出的。但僅在幾個月前,也就是2017年11月,Sara Sabour, Nicholas Frosst和Geoffrey Hinton發表了一篇名為“膠囊間動態路由(Dynamic Routing between Capsules)”的論文,介紹了一個CapsNets結構,在MNIST(手寫數字圖像的著名數據集)上達到了較好性能,并在MultiMNIST(不同數字對重疊形成的變形手寫數字圖像數據集)上獲得了比CNNs好得多的結果,見圖3。?

圖3 MultiMNIST 圖像(白色) 和CapsNets重構圖像 (紅色+綠色)。“R”代表重構 ,“L”代表標簽. 如:這一個例子預測(左上)是正確的,重構圖像也是正確的。但第5個例子預測是錯的,(5,0)預測成了(5,7)。因此,5被正確重構,而0卻沒有。圖形來自論文《Dynamic routing between capsules》, 引用得到作者許可。

盡管CapsNets具有很多有點,但它仍遠不夠完美。首先,現在CapsNets在如CIFAR10或ImageNet大規模圖像測試集上的表現不如CNNs好。而且,CapsNets需要大量計算,不能檢測出相互靠近的同類型的兩個對象(這被稱為“擁擠問題”,且已被證明人類也存在這個問題)。但CapsNets的主要思想還是非常有前途的,似乎只需要一些調整就可以發揮全部潛力。畢竟,現在的CNNs是在1998年發明的,經過一些調整后,就在2012年在ImageNet數據集上戰勝了技術。

那么,CapsNets到底是什么?

簡而言之,CapsNet由膠囊而不是神經元組成。膠囊是用于學習檢測給定圖像區域內特定對象(如矩形)的一小組神經元,它輸出一個向量(如一個8維矢量),該向量的長度表示被檢測對象存在的估計概率,而方向(如在8維空間中)對被檢測對象的姿態參數(如較精確的位置,旋轉等)進行編碼。如果被檢測對象發生稍微改變(如移動、旋轉、調整大小等),則膠囊將輸出相同長度的矢量,但方向稍有不同。這樣,膠囊是等變的。

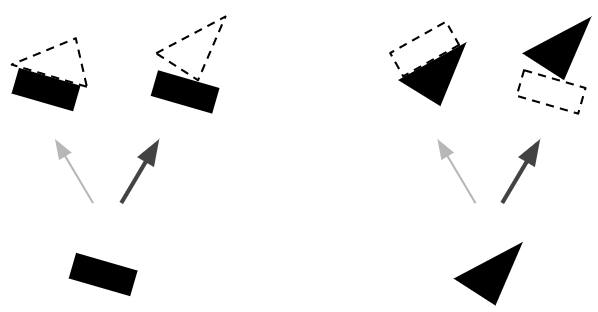

就像常規的神經網絡一樣,一個CapsNet也是按多個層組織的(見圖4)。最下層的膠囊被稱為主膠囊:每個膠囊都接收圖像的一個小區域作為輸入(稱其為接受場),嘗試檢測一個特定模式的存在和姿態,如矩形。更高層的膠囊稱為路由膠囊,檢測更大更復雜的對象,如船只。

圖4 兩層膠囊網絡。這個例子中,初始膠囊層有兩個5×5映射,而第二個膠囊層有兩個3×3映射。每個膠囊輸出一個向量,每個箭頭符號表示一個不同膠囊的輸出,藍色箭頭符號表示一個嘗試檢測三角形的膠囊的輸出,黑色箭頭符號表示一個嘗試檢測矩形的膠囊的輸出。圖像由AurélienGéron提供。

主膠囊層采用幾個常規的卷基層來實現。如本文使用兩個卷基層輸出256個包含標量的6×6特征映射,并將這個輸出轉變成32個包含8維矢量的6×6映射。最后,使用一個新穎的壓縮函數來確保這些向量的長度在0到1之間(表示一個概率)。這樣就給出了主膠囊的輸出。

下幾層膠囊也嘗試檢測對象及其姿態,但工作方式非常不同,即使用按協議路由算法。這就是膠囊網絡的較大魔力所在。我們來看一個例子。

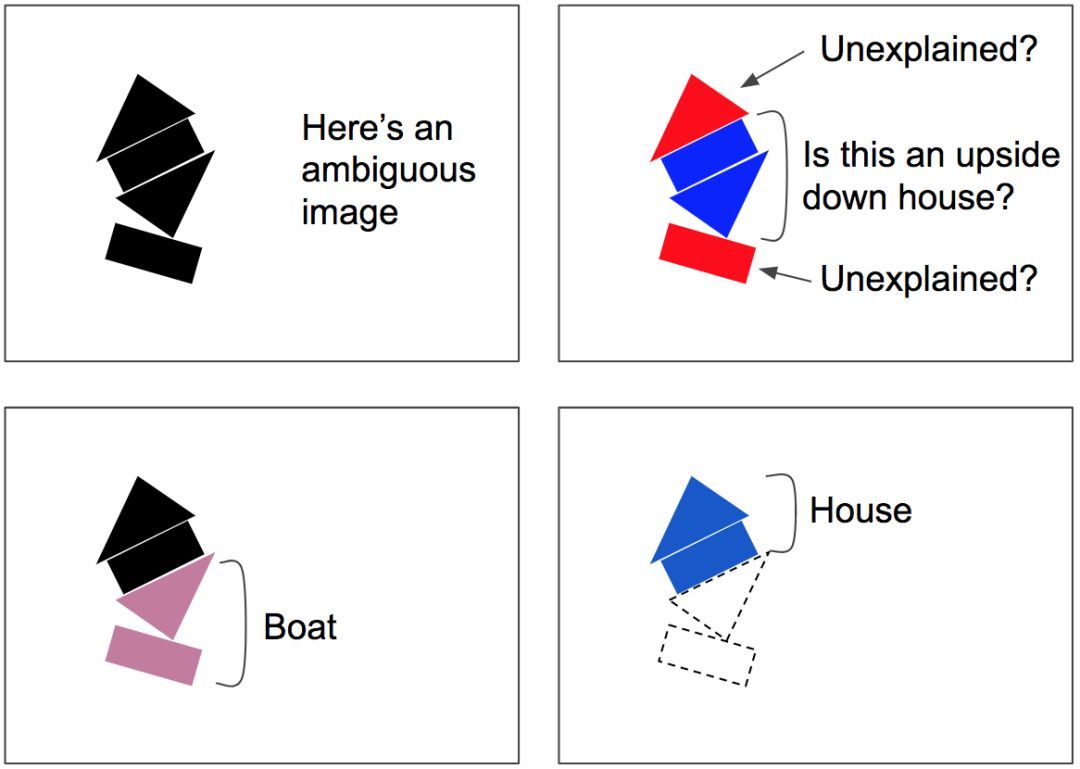

假設只有兩個主膠囊:一個長方形膠囊和一個三角膠囊,假設它們都檢測到正在尋找的東西。矩形和三角形都可能是房子或船的一部分(見圖5)。由于長方形的姿態是略微向右旋轉的,房子和船也得是稍微向右旋轉。考慮到三角形的姿態,房子就得幾乎是顛倒的,而船會稍微向右旋轉。注意,形狀和整體/部分關系都是在訓練期間學習的。現在注意長方形和三角形對船的姿態達成一致,而對房子的姿態強烈不一致。所以,矩形和三角形很可能是同一條船的一部分,并沒有房子的存在。

圖5 按協議路由,第1步—基于存在的部分對象及其姿態去預測對象及其姿態,而后在預測結果之間尋求一致性。圖像由AurélienGéron提供。

既然現在確信長方形和三角形是船的一部分,那么將長方形和三角形膠囊的輸出結果更多地發送給船膠囊,而更少發送給房子膠囊,將更有意義:這樣,船膠囊將接收更有用的輸入信號,而房子膠囊將會收到較少的噪聲。對于每個連接而言,按協議路由算法包含一個路由權重(見圖6):達成一致時,增大路由權重;出現分歧時,減少路由權重。

圖6 按協議路由,第2步—更新路由權重。圖像由AurélienGéron提供。

按協議路由算法包括協議檢測+路由更新的一些迭代(注意,每次預測這都會發生,不只是一次且也不僅是在訓練時間)。這在擁擠的場景中特別有用:如圖7中,場景是存在歧義的,因為你從中間看到的可能是倒置的房子,但是這會使底部的矩形和頂部的三角形無法解釋。協議算法很可能會給出更好的解釋:底部是一只船,頂部是一個房子。這種模棱兩可的說法被認為是“可解釋過去的”:下面的矩形較好用船的存在來解釋,這也解釋了下面的三角形,一旦這兩個部分被解釋清楚,剩下的部分就很容易被解釋為一個房子。

圖7按協議路由能解析擁擠場景,如可被誤解為顛倒的房子而其他部分無法解釋的存在歧義的圖像。但底部矩形路由給船,同時底部三角形將也路由給船。一旦船被解釋清楚,那么很容易將頂部解釋為房子。圖像由AurélienGéron提供。

原文鏈接

https://www.oreilly.com/ideas/introducing-capsule-networks?utm_source=feedburner&utm_medium=feed&utm_campaign=Feed%3A+oreilly%2Fradar%2Fatom+%28O%27Reilly+Radar%29

歡迎加入本站公開興趣群商業智能與數據分析群

興趣范圍包括各種讓數據產生價值的辦法,實際應用案例分享與討論,分析工具,ETL工具,數據倉庫,數據挖掘工具,報表系統等全方位知識

QQ群:81035754

文章版權歸作者所有,未經允許請勿轉載,若此文章存在違規行為,您可以聯系管理員刪除。

轉載請注明本文地址:http://m.specialneedsforspecialkids.com/yun/4731.html

摘要:而加快推動這一趨勢的,正是卷積神經網絡得以雄起的大功臣。卷積神經網絡面臨的挑戰對的深深的質疑是有原因的。據此,也斷言卷積神經網絡注定是沒有前途的神經膠囊的提出在批判不足的同時,已然備好了解決方案,這就是我們即將討論的膠囊神經網絡,簡稱。 本文作者 張玉宏2012年于電子科技大學獲計算機專業博士學位,2009~2011年美國西北大學聯合培養博士,現執教于河南工業大學,電子科技大學博士后。中國計...

摘要:本文從可視化的角度出發詳解釋了的原理的計算過程,非常有利于直觀理解它的結構。具體來說,是那些水平方向的邊緣。訓練過程可以自動完成這一工作。更進一步地說,這意味著每個膠囊含有一個擁有個值的數組,而一般我們稱之為向量。 CapsNet 將神經元的標量輸出轉換為向量輸出提高了表征能力,我們不僅能用它表示圖像是否有某個特征,同時還能表示這個特征的旋轉和位置等物理特征。本文從可視化的角度出發詳解釋了 ...

摘要:等人最近關于膠囊網絡的論文在機器學習領域造成相當震撼的影響。它提出了理論上能更好地替代卷積神經網絡的方案,是當前計算機視覺領域的技術。而這就是這些膠囊網絡運行方式的本質。為了簡化,我們將假設一個兩層的膠囊網絡。產生的結果值將被稱為。 Geoff Hinton等人最近關于膠囊網絡(Capsule networks)的論文在機器學習領域造成相當震撼的影響。它提出了理論上能更好地替代卷積神經網絡的...

摘要:鏈接是他們在數據集上達到了較先進的性能,并且在高度重疊的數字上表現出比卷積神經網絡好得多的結果。在常規的卷積神經網絡中,通常會有多個匯聚層,不幸的是,這些匯聚層的操作往往會丟失很多信息,比如目標對象的準確位置和姿態。 PPT由于筆者能力有限,本篇所有備注皆為專知內容組成員根據講者視頻和PPT內容自行補全,不代表講者本人的立場與觀點。膠囊網絡Capsule Networks你好!我是Aurél...

摘要:在底層的膠囊之后連接了層和層。膠囊效果的討論在論文最后,作者們對膠囊的表現進行了討論。他們認為,由于膠囊具有分別處理不同屬性的能力,相比于可以提高對圖像變換的健壯性,在圖像分割中也會有出色的表現。 背景目前的神經網絡中,每一層的神經元都做的是類似的事情,比如一個卷積層內的每個神經元都做的是一樣的卷積操作。而Hinton堅信,不同的神經元完全可以關注不同的實體或者屬性,比如在一開始就有不同的神...

閱讀 2542·2021-10-12 10:12

閱讀 1723·2019-08-30 15:52

閱讀 2458·2019-08-30 13:04

閱讀 1746·2019-08-29 18:33

閱讀 969·2019-08-29 16:28

閱讀 456·2019-08-29 12:33

閱讀 2066·2019-08-26 13:33

閱讀 2369·2019-08-26 11:36